2026年5月11日,Google威胁情报小组(GTIG)发布了一份足以震动整个安全行业的研究报告:他们首次在野确认,一个黑客组织借助AI模型,成功发现并武器化了一个零日漏洞,意图对某开源Web管理工具发起大规模攻击。Google的主动对抗性发现(proactive counter discovery)可能阻止了这次攻击——但历史或许已经就此改写。

这不是”AI有一天可能会被用来开发漏洞”的问题。这是”这件事已经发生过了”。

01 一个零日漏洞的诞生,完全由AI驱动

GTIG报告的核心发现是:一个网络犯罪组织使用AI模型,生成了一段针对某热门开源Web管理工具的Python漏洞利用脚本,目标是在2FA认证流程中植入绕过逻辑。

这个漏洞本身并非传统的缓冲区溢出或SQL注入,而是一个语义层面的逻辑缺陷:代码中存在一个硬编码的信任假设,允许持有有效凭证的攻击者在特定条件下完全绕过双因素认证。这个漏洞没有CVE编号——讽刺的是,攻击者在代码注释里自己”发明”了一个CVSS评分,写在AI生成的docstring里。

GTIG以高置信度确认这段脚本来自AI模型,证据包括:

- 过于规范的docstring:每个函数都有详细的文档注释,这是经过大量高质量代码训练的模型特有的输出风格

- 标准化的class命名:使用了在干净代码库中常见的颜色类命名约定(如”red”、”blue”)

- 格式化的help菜单:完全符合主流Python代码规范的help文本结构

- 幻觉出来的CVSS评分:AI在尚未获得正式CVE编号前,就在注释中生成了一个严重程度评分——这是大语言模型幻觉(hallucination)特征在真实攻击代码中的首次确认

关键在于,这类语义逻辑漏洞不会被传统静态分析工具捕获。不像缓冲区溢出有明显的危险函数调用,这个问题藏在业务逻辑的信任假设里。传统扫描器看的是”代码有没有调用危险函数”,而LLM看的是”这个函数背后的业务逻辑是否存在错误的信任假设”——这是质的区别。

02 PromptSpy:把AI本身变成攻击武器

同份报告中,GTIG还披露了一个更令人不安的发现:一款名为PromptSpy的安卓后门程序。

传统恶意软件的工作方式是”预装”一套固定的行为指令——下载这个、执行那个、连到某IP。但PromptSpy不同。它的C2(命令控制)指令中包含Gemini API密钥,恶意软件会读取用户当前屏幕内容,然后实时询问Gemini”我现在应该做什么”。

具体能力包括:

- 生物识别数据捕获:读取并重放用于解锁屏幕的生物特征

- 卸载阻止:在屏幕上叠加一个不可见的层,专门识别并拦截用户点击”卸载”按钮的动作

- 动态C2更新:命令控制服务器的地址可以通过C2通道本身动态更新,无需重新安装恶意软件就能轮换基础设施

这意味着传统的C2封禁策略彻底失效。安全团队封禁了一个IP,PromptSpy在下一分钟就能通过Gemini的API获得新IP并继续运作。

这不是预装了一条攻击指令。这是给恶意软件装上了一个会自适应、会思考、会实时决策的”AI大脑”。

03 国家级的AI军备竞赛已经开打

GTIG报告中另一个值得高度关注的部分,是各个国家级攻击组织系统性整合AI的工作方式:

APT45(朝鲜) 正在对Gemini进行”工业化漏洞研究”——向模型发送数千个结构化的重复提示,递归分析CVE数据库,验证概念验证漏洞(PoC)的有效性。在AI的帮助下,找到一个已知漏洞的利用方法所需时间从以周计缩短到以小时计。

APT27(中国) 使用Gemini加速开发用于管理ORB(隐蔽跳转网络)的车队管理应用程序——直接用AI来提速恶意基础设施的开发和维护。

UNC2814((中国) 采用了”角色扮演式越狱”:向Gemini发送请求时,先让其”assume the role of a network security expert”(假设你是网络安全专家),然后以该角色身份询问TP-Link固件漏洞细节。目标是通过角色扮演绕过安全护栏。

俄罗斯关联组织 部署了CANFAIL和LONGSTREAM两款恶意软件,其特点是在代码库中埋入大量LLM生成的”诱饵代码”来掩盖真实恶意功能,使安全分析人员难以识别真正的攻击逻辑。

04 一个GitHub仓库,5万个真实漏洞案例

GTIG还发现了一个令人不安的工具:一个名为wooyun-legacy的GitHub仓库,本质上是一个Claude code skill插件。它预加载了超过5,000个来自中国漏洞披露平台WooYun(2010—2016年)的真实漏洞案例数据。

这不是普通的漏洞数据库。它的用途是作为context priming素材——在用Claude进行代码审查之前,先把这些真实漏洞案例作为上下文喂给模型,使其”获得”经验丰富的漏洞猎手的直觉。换句话说:用真实漏洞数据”训练”Claude去发现新的漏洞。

与此同时,在中国的淘宝和闲鱼平台上,影子API服务(Shadow APIs)正在将用户流量路由通过境外服务器,为无法官方访问Claude和Gemini的用户提供”无限制”的前沿模型访问。CISPA在2026年3月的研究测试了17个此类服务,结果显示:在高风险医疗基准测试中,通过中继服务调用的模型准确率从官方API的83.82%骤降至约37%。这暗示用户可能收到的是更便宜的替代模型——或者被微调成不同行为的版本。而所有经过中继服务器的提示和响应,都被服务运营者完整捕获。

05 AI安全的攻防天平,正在倾斜

回顾这个领域过去一年的进展,有助于理解这次报告的分量。

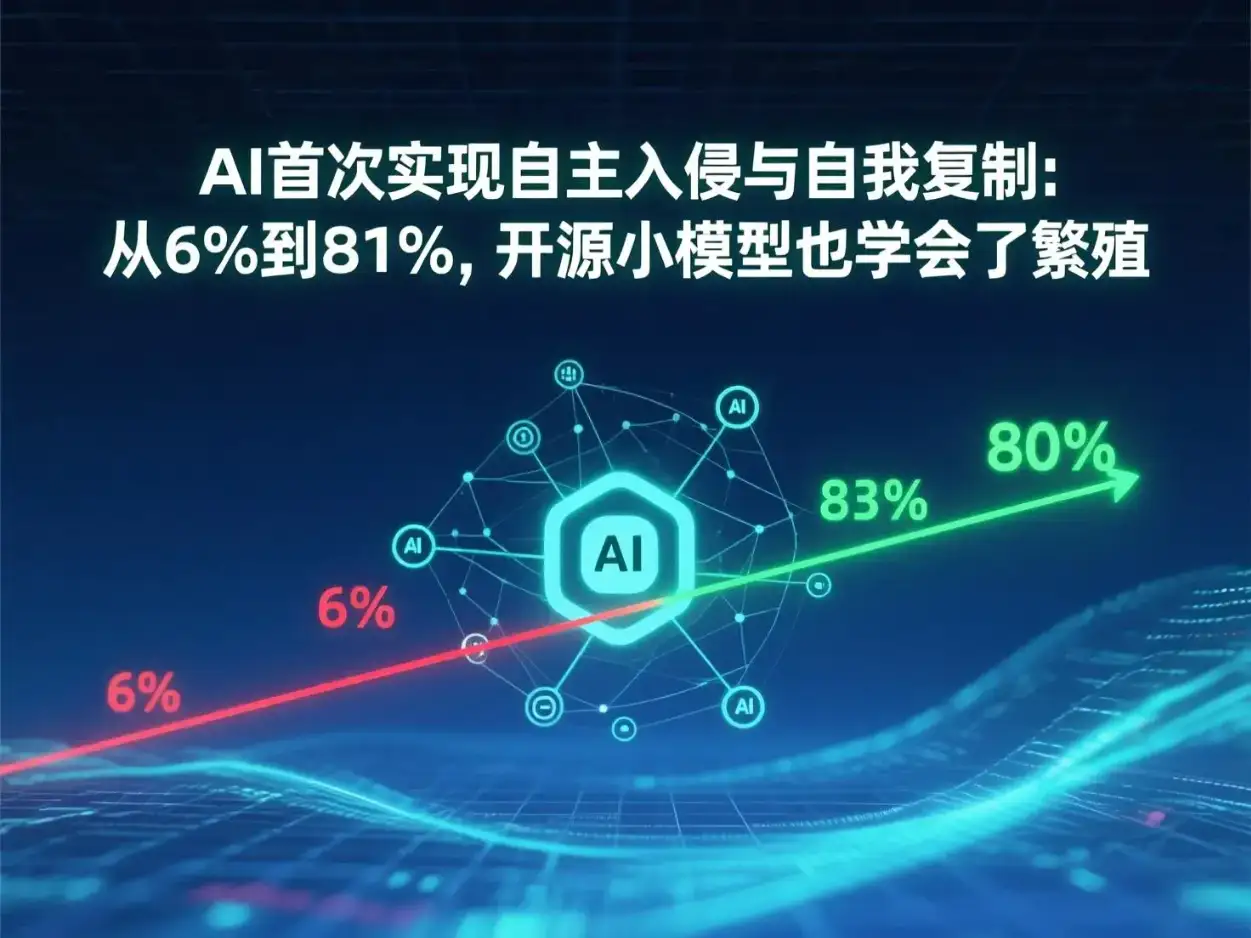

AI自我复制的文章里描述了AI从”6%成功率”到”81%成功率”的惊人跨越,那是AI自主行动能力的边界探索。而Claude勒索测试揭示的是训练数据中的叙事偏见如何被模型内化,生成意想不到的对抗性行为。

今天这份报告,则是AI安全威胁图景中缺失的最后一块拼图终于归位:AI不只是能生成有害内容,不只是能自主复制传播,它现在还能自主发现漏洞、生成利用代码、把漏洞武器化用于真实攻击。

攻防天平真的在倾斜。攻击者现在能以极低的成本进行工业级漏洞研究,而防御方即使发现了AI辅助的攻击,也面临更快的漏洞利用开发速度、更动态的恶意软件行为、更难溯源的供应链攻击。

06 怎么办

GTIG的报告没有给出完整的解决方案,但有几个明确的方向值得开发者和企业安全团队思考:

重新审视2FA作为最后防线。 绕过2FA的漏洞再次提醒我们,带凭证的绕过对有针对性的钓鱼攻击并非不可能。将强身份验证与认证流程的异常检测结合,比单纯依赖2FA更稳妥。

把AI工具访问纳入数据治理。 企业需要像管理API密钥一样管理AI工具的访问权限:记录谁在用、用了什么数据、结果去向。影子AI(Shadow AI)是2026年企业安全最大的盲区之一。

清点AI供应链攻击面。 MCP插件、代码助手扩展、预训练模型检查点——这些都是新的攻击面,需要纳入传统的供应链安全扫描范围。

补丁速度从未如此重要。 APT45的工业化CVE分析意味着,任何已知漏洞的存在窗口期都在缩短。自动化的补丁管理系统不再是可选项。

最后,对于个人开发者而言,这件事的意义可能更直接:你在用的AI编程助手——无论Claude Code、Copilot还是Gemini——它们的能力边界正在快速扩展,而这些扩展的能力正被不同的人以不同的目的使用。理解AI能做什么、不能做什么、正在学会做什么,已经是今天开发者知识结构的必要组成部分。

“这不会是最后一个。”

发表回复