3月19日凌晨,大多数人还在睡觉,小米官方账号突然在各大平台同步发布:三款自研大模型同步上线,开放API调用。

这不是什么预热好的发布会,更像一次蓄谋已久的突袭。

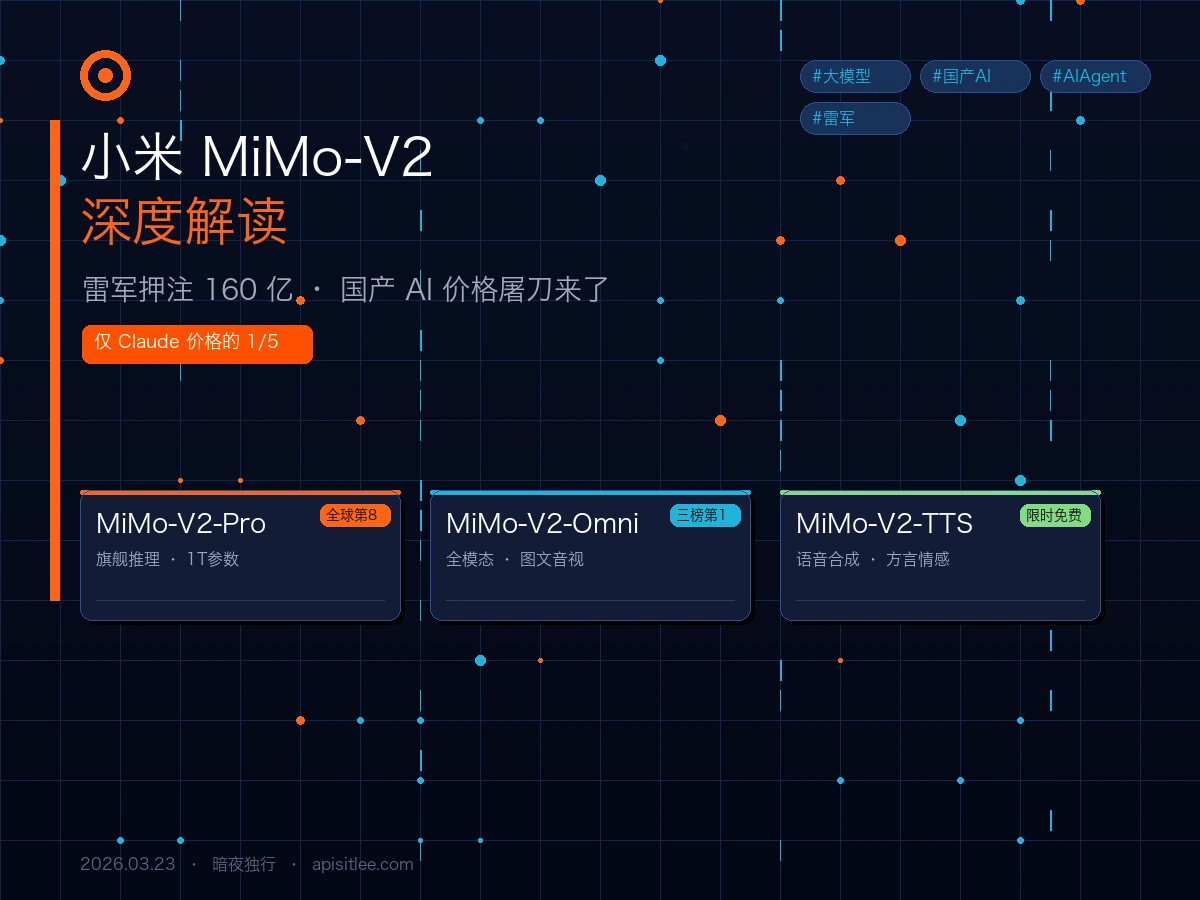

模型名叫 MiMo-V2,分三款——Pro、Omni、TTS。雷军随即在微博宣布:2026年小米AI研发和资本投入将超过160亿元。

消息一出,开发者社区沸腾了。原因很简单:性能逼近Claude Opus,价格只有五分之一。

从”Hunter Alpha”说起:这款模型你其实早见过

发布前几周,开发者圈子里流传着一个叫”Hunter Alpha”的神秘模型,不少人拿它和DeepSeek对比,发现它在代码生成、复杂推理方面出奇地强。

现在谜底揭晓:Hunter Alpha,就是MiMo-V2-Pro的内测版本。

小米一直在悄悄做,等到时机成熟,一次打出三张牌。

MiMo-V2 三款模型,各自管什么

Pro:Agent时代的重型引擎

MiMo-V2-Pro是这次发布的核心,冲着”AI Agent旗舰”这个定位去的。

几个关键参数值得关注:

- 1万亿总参数,激活42B:混合注意力架构,兼顾能力和推理效率

- 100万Token超长上下文:能装下大概75本《哈利波特》全集的文本量

- 综合智能全球第八:在Artificial Analysis排行榜上,按厂商品牌排全球第五

在代码能力评测Claw-Eval上,MiMo-V2-Pro平均得分75.7分,全球前三,仅次于Claude Opus 4.6。

这意味着什么?如果你在用AI辅助写代码、处理长文档、做工作流编排,它是一个值得认真对待的选项。

Omni:看得见、听得到、读得懂

MiMo-V2-Omni是小米的”感知”模型——处理图像、视频、音频、文本,一个模型全包。

和市场上那些”拼接式”多模态模型不同,Omni采用统一架构,不是把几个模型缝合在一起,而是原生支持跨模态理解。

几个亮眼的能力:

- 音视频联合推理:看一段视频,能同时理解画面内容、背景音乐、人物对话

- 10小时以上音频深度理解:会议录音、播客全集,一次丢进去

- PinchBench音频、视频、视觉三榜全部第一

小米还和WPS达成合作,Omni将直接接入WPS的智能体功能。对普通用户来说,这意味着Office场景下的AI升级可能比你想象中来得更快。

TTS:会说方言的AI

MiMo-V2-TTS主打一个字:自然。

目前支持四川话、河南话、粤语、台湾腔和普通话,更重要的是支持句中情感切换——同一句话里,从平静到激动,AI能感知语境、切换语气。

还能合成歌声,且支持音高精准控制。

TTS目前限时免费开放API,有语音相关需求的开发者可以直接去试。

价格才是真正的杀手锏

技术参数容易让人头皮发麻,但这张定价表才是真正让竞争对手坐不住的东西:

| 模型 | 上下文窗口 | 输入价格 | 输出价格 |

|---|---|---|---|

| MiMo-V2-Pro | ≤256K tokens | $1.00/百万tokens | $3.00/百万tokens |

| MiMo-V2-Pro | ≤1M tokens | $2.00/百万tokens | $6.00/百万tokens |

| MiMo-V2-Omni | ≤256K tokens | $0.40/百万tokens | $2.00/百万tokens |

| MiMo-V2-TTS | — | 限时免费 | — |

对比一下:Claude Opus同级别API,成本大约是MiMo-V2-Pro的五倍。

这不是微幅降价,是降维打击。

而且MIT协议开源——你可以拿去商用,不用交许可费。

中国大模型正在全球被用起来

小米的发布不是孤立事件。就在上周,OpenRouter(全球最大AI模型API聚合平台)发布了一组数据:

截至3月15日当周,中国AI大模型周调用量达到4.69万亿Token,连续第二周超越美国,全球前三名均为中国模型。

这意味着什么?不只是中国用户在用中国模型,是全球开发者主动选择调用中国模型。

摩根大通的预测更激进:中国AI推理Token消耗量将从2025年的约10千万亿,增长到2030年的约3900千万亿——增长近400倍。

行业竞争的焦点,已经从”谁的模型参数更多”,转向”谁的模型真正被用起来”。

开发者怎么上手

MiMo-V2兼容OpenAI接口格式,如果你已经在用OpenAI SDK,切换成本几乎为零。

第一步:去 platform.xiaomimimo.com 用小米账号登录,创建API Key

第二步:装SDK

pip install -U openai

第三步:改一行base_url,直接调

from openai import OpenAI

client = OpenAI(

api_key="你的 MiMo API Key",

base_url="https://api.xiaomimimo.com/v1"

)

response = client.chat.completions.create(

model="mimo-v2-pro",

messages=[

{"role": "user", "content": "帮我分析这段代码有没有性能问题..."}

]

)

print(response.choices[0].message.content)

Code language: JavaScript (javascript)此外,小米还宣布通过OpenClaw、Cline、KiloCode等主流AI编程工具提供免费试用一周的资格,开发者可以直接在熟悉的IDE里体验。

国产大模型的下一步棋

从DeepSeek到MiMo-V2,国产大模型正在打出一套相似的组合拳:开源协议 + 极致定价 + 性能对标头部。

这套打法的目的不是赢得某个评测榜单,而是要成为基础设施——就像云计算从奢侈品变成水电一样,让AI调用从”按需谨慎使用”变成”随手就调”。

小米的加入,让这场竞争更有意思了。毕竟雷军不只有160亿的投入预算,还有手机、汽车、IoT构成的庞大生态——这些场景,都是MiMo-V2系列天然的落地实验场。

对于普通开发者来说,这是好消息:可用的高质量AI能力越来越便宜,越来越多。

快速小结

| 维度 | 要点 |

|---|---|

| 🚀 发布时间 | 2026年3月19日深夜 |

| 🧠 旗舰模型 | MiMo-V2-Pro:1T参数,1M上下文,全球第八 |

| 👁️ 多模态 | MiMo-V2-Omni:图文音视频统一架构,三榜第一 |

| 🗣️ 语音 | MiMo-V2-TTS:情感方言合成,限时免费 |

| 💰 价格 | Pro仅$1/百万tokens输入,约为Claude的1/5 |

| 📦 开源协议 | MIT,可商用 |

| 💸 雷军承诺 | 2026年AI投入超160亿元人民币 |

你怎么看这波操作?如果你已经在用或者打算尝试MiMo-V2,欢迎在评论区聊聊。

相关阅读

发表回复